AI業界で静かに起きている「安全性」をめぐる動き

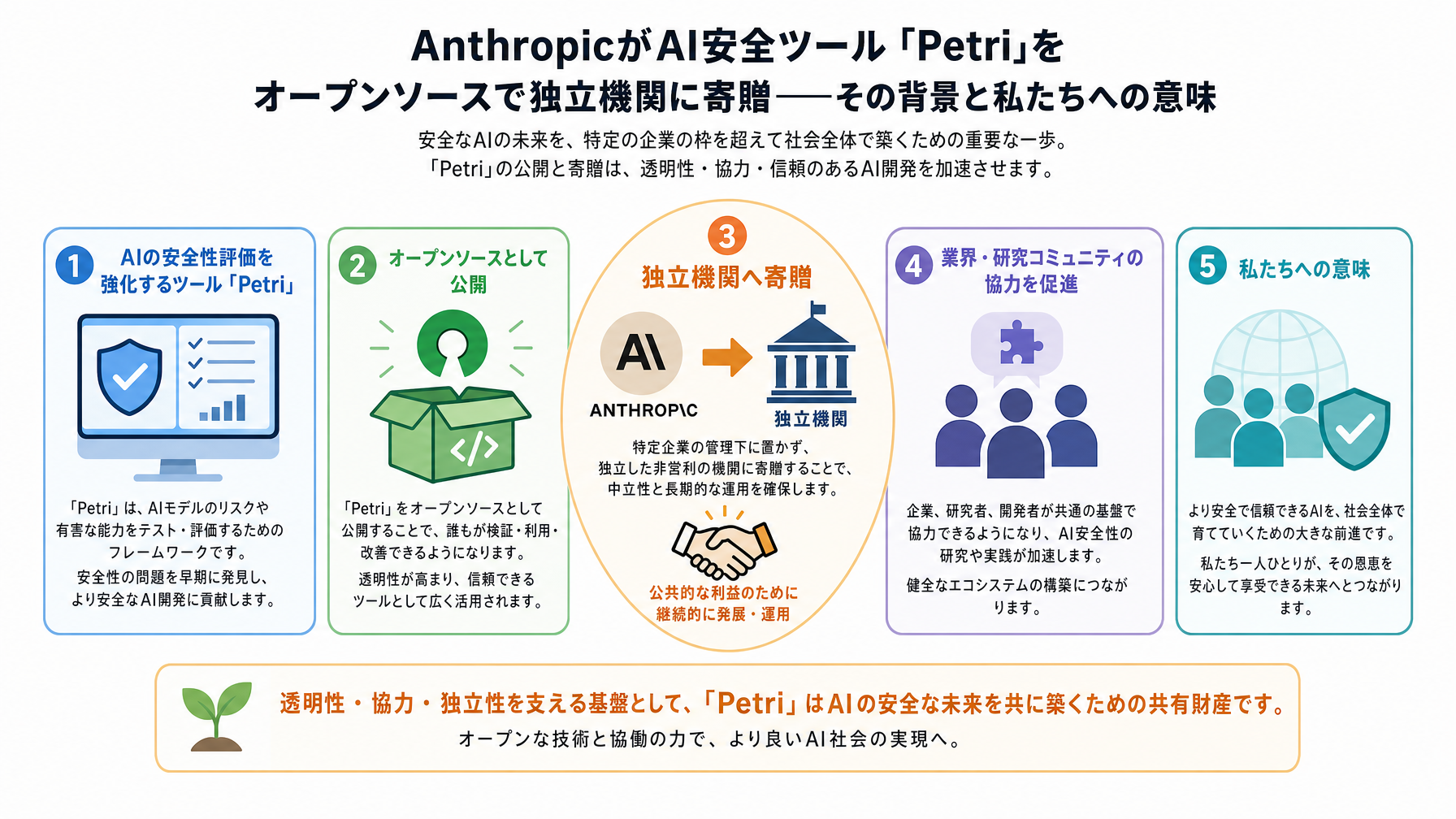

AIツールの進化ばかりが話題になりますが、その裏側では「AIが暴走しないか」を検証する地味で重要な作業が続いています。2025年、AIの安全研究で知られるAnthropicが、自社の検証ツール「Petri」を外部機関に寄贈するという、少し変わった発表をしました。

この記事では、その発表の内容と、なぜこれが注目に値するのか、そしてAIツールを使い始めた私たちにとって何を意味するのかを整理します。技術的な話は最小限にとどめ、「ビジネスパーソンとして知っておくべき文脈」に絞って読み解いていきます。

「Petri」って何? 難しくない基本の話

Petriは、AIが「危険な動作をしないか」を自動でテストするためのツールです。もう少し具体的に言うと、AIモデルに対してさまざまな状況を仮想的に作り出し、「悪意ある指示に従ってしまわないか」「偏った判断をしていないか」などを確かめるための実験環境です。

「アライメント(alignment)」という言葉が出てきたら、「AIが人間の意図や価値観に沿って動くかどうかの整合性」と読み替えてください。ChatGPTが突然おかしな回答をしてしまうリスクを事前に発見・修正するための研究領域です。

PetriはこれまでAnthropicが社内ツールとして開発してきたものですが、今回それをオープンソース(誰でも中身を見て使えるソフトウェア)として、独立した研究機関「Meridian Labs」に寄贈することを発表しました。

あわせて、Meridian Labsとの共同作業で大型アップデートも実施。テストの「適応性・リアリティ・深度」が改善されたとのことです。

なぜ自社ツールを「手放す」のか

企業が自ら作ったものを渡す理由

ここが一番の疑問点だと思います。普通なら、競合優位性になるツールを自社で持ち続けるはず。なのになぜ?

一つの答えは「信頼性の担保」です。AI安全性のツールが、AI開発会社の傘下だけで管理されているとしたら、第三者からの信頼を得にくい側面があります。自動車メーカーが自社の車の安全基準を自分たちだけで決めているようなものです。

独立した機関が管理することで、「中立性」と「継続性」が生まれます。Anthropicが方針を変えても、Petriの開発は止まらない。これはAI業界全体にとって意味のあるアーキテクチャです。

オープンソース化がもたらすもの

オープンソース化によって、世界中の研究者や開発者がPetriを使って独自のAI安全テストを実施できるようになります。バグの発見も早まりますし、多様な視点が入ることでテストの精度も上がります。

MicrosoftがVSCodeを、MetaがLlamaを公開してきた流れと本質は同じです。「囲い込み」より「エコシステム構築」を選ぶ戦略です。

AIアライメント研究、今どこまで来ているのか

「テスト」という工程の重要性が増している

2024〜2025年にかけて、生成AIの能力は急速に上がりました。それに比例して、「テストとチェック」の重要性も高まっています。

GoogleやOpenAI、そしてAnthropicなどは、それぞれ独自のレッドチーミング(意図的に攻撃的な使い方を試みる安全テスト)を実施しています。ただ、手法が各社バラバラでは、業界横断の信頼基準が作れません。

Petriのようなオープンなツールが普及することで、「この基準をクリアしたAIは安全とみなす」という共通言語が生まれやすくなります。EUのAI規制(AI Act)など、法的な要求水準も厳しくなっている中で、業界標準化の動きは加速するでしょう。

会社員が知っておくべき「使う側のリスク管理」

ここで少し視点を変えます。

職場でChatGPTやClaudeを使っている方なら、「このAIの出力、どこまで信用していいの?」と感じた経験が一度はあるはずです。

Petriのようなツールが発展することは、企業が提供するAIサービスの品質保証のインフラが整っていくことを意味します。AIが「なんとなく良さそう」から「検証済みで信頼できる」へと変わるための土台づくりです。

使う側の私たちにとっては、直接操作するツールではありません。ただ、AIの信頼性向上に関係する動きとして、頭の片隅に置いておく価値はあります。

独自分析:Anthropicの「手放す」判断が示すAI業界のトレンド

以下は、直近のAI関連のオープンソース寄贈・公開事例を簡単に整理したものです。

| 企業 | 公開・寄贈したもの | 狙い |

|---|---|---|

| Anthropic | Petri(安全テストツール) | 業界標準化・中立性確保 |

| Meta | Llama 3(言語モデル) | エコシステム構築・普及 |

| Gemma(軽量モデル) | 研究コミュニティの取り込み | |

| OpenAI(2015当時) | 研究成果の一部公開 | 学術的信頼獲得(現在は方針転換) |

この表を見ると、「安全性に関するツール」の公開はPetriが先進的な事例であることがわかります。性能競争の横で、安全性の透明化をめぐる競争も起き始めています。

Anthropicの今回の判断は、「安全性の担保は独占しない」という明確なメッセージでもあります。同社がClaude(クロード)という商用AIで収益を上げながら、安全研究の成果をコモンズ(共有財)として開放する——この両立がどこまで可能か、今後の動向が注目されます。

まとめ

- AnthropicはAI安全性テストツール「Petri」を独立機関Meridian Labsに寄贈し、オープンソースとして開発を継続させることにしました。

- 自社ツールを「手放す」背景には、AI安全性の中立性・業界標準化という戦略的な意図があります。

- 使う側のビジネスパーソンにとっては、AIの品質保証の仕組みが整いつつあることを示す動きとして注目に値します。

次のアクション: AIを業務で使い始めたなら、「どのAIが何を保証しているか」を意識するだけで、使い方の質が変わります。まずは自分が日常使いしているAIツールの「安全・品質方針」ページを一度だけ眺めてみてください。難しくありませんし、選択眼が一段上がります。

AIの使い方をもっと深めたい方は、ChatGPTの基本的な使い方ガイドや、業務に活かすためのプロンプトの書き方入門もあわせてどうぞ。