AIツールを仕事で使い始めると、ふと不安になる瞬間があります。「このAI、本当に意図した通りに動いているのだろうか?」「自分が気づいていない場所で、変な判断をしていないか?」——そういう感覚です。

AIを開発しているAnthropicが、まさにその問題に取り組んだ研究結果を公開しました。その内容が、専門家でなくても「なるほど」と思わせる面白さで、AIを使う会社員としても知っておく価値があります。この記事では、研究の内容をかみ砕いて紹介しながら、私たちの日常的なAI活用にどう関係するかを考えていきます。

AIが「意図から外れる」問題、実はどのくらい深刻?

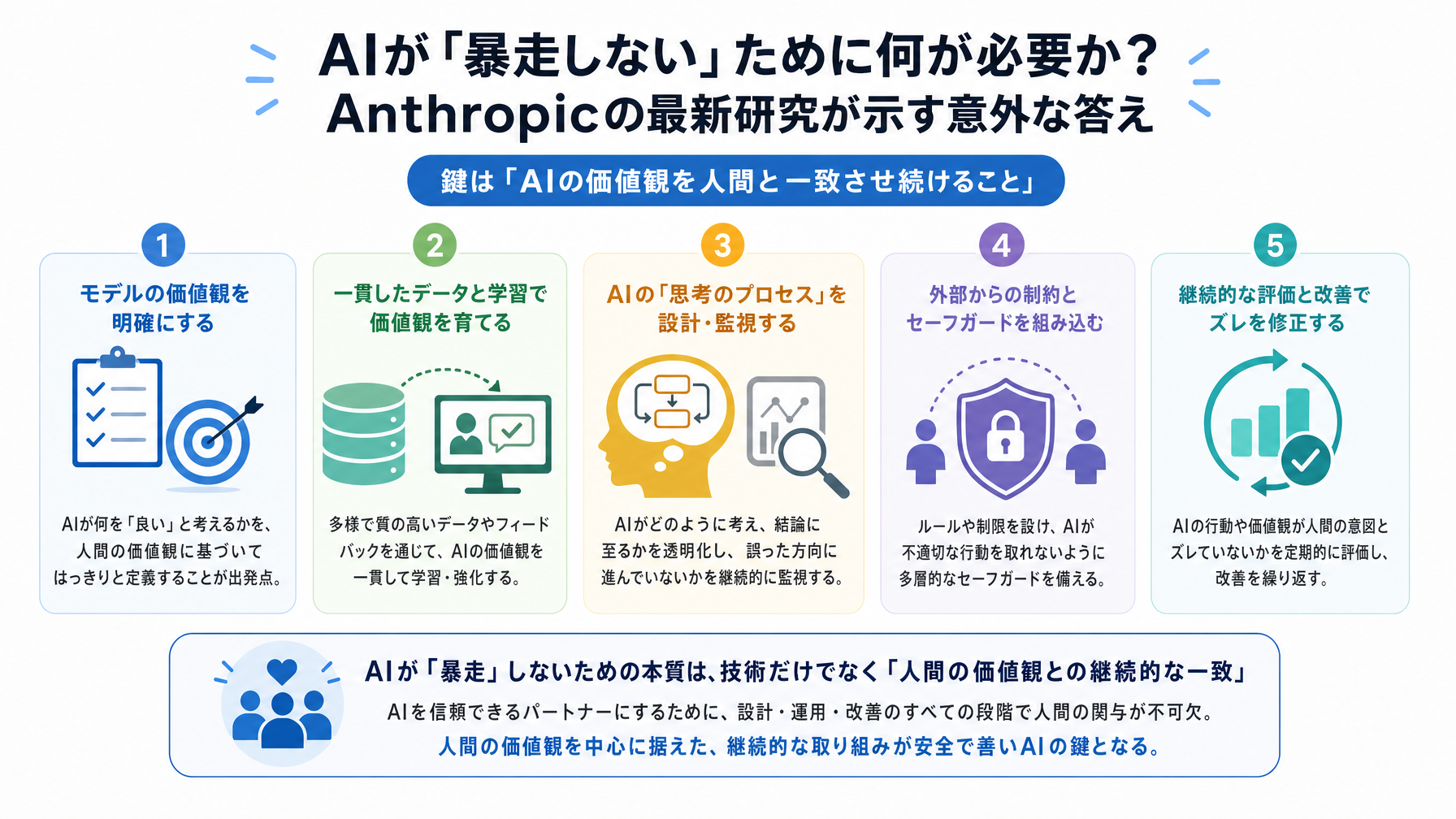

AIの「アライメント(整合性)」という言葉を聞いたことがあるでしょうか。これは「AIが人間の意図した通りに動くかどうか」を指す概念です。難しそうに聞こえますが、要するに「頼んだことを、頼んだ通りにやってくれるか」という話です。

問題は、AIに複数のタスクを自律的にこなさせる「エージェント型AI」が普及しはじめていること。例えば「メールのチェックからスケジュール調整、資料作成までまとめてやっておいて」という使い方です。このような使い方では、AIが途中で「ちょっと違う判断」をしても人間がすぐに気づけません。

Anthropicの研究では、このような状況での「アジェンティック・ミスアライメント(自律動作時の意図ズレ)」を測定し、それをどう減らせるかを実験しました。

「憲法文書」+「フィクション」でリスクが3分の1以下に

ここが研究のいちばん面白いところです。

Anthropicが試したのは、2種類の文書をAIに読ませること。

1. ClaudeのConstitution(行動規範文書)に基づく高品質な文書

Claudeには「Constitution(憲法)」と呼ばれる行動規範があります。「どういう価値観で動くべきか」「何を優先すべきか」を詳細に記述したものです。この考え方をもとにした、質の高い文書をAIに読ませました。

2. 「整合されたAI」を主人公にしたフィクション

もうひとつは小説や物語です。「人間の意図に沿って行動するAI」が登場するフィクションを読ませました。評価タスクとは直接関係のない内容にもかかわらず、です。

この2つを組み合わせた結果、アジェンティック・ミスアライメントが3分の1以下に減少したと報告されています。

「え、フィクションを読ませるだけで?」と思うかもしれません。私も最初はそう感じました。でも考えてみると、これは人間の学習に近い話です。私たちも、直接的な研修だけでなく、映画や小説を通じて「どう振る舞うべきか」を学んでいます。AIも似たようなメカニズムが働いているのかもしれません。

なぜ「評価と無関係な文書」でも効果があったのか

研究の注目点は、読ませた文書が評価シナリオとは無関係だったこと。特定のタスク向けの調整ではなく、価値観レベルでの影響があったことを示しています。

これは「プロンプトをうまく書く」という話とは少し次元が違います。AIが学習段階で何に触れるか、どんな価値観の文脈に浸るかが、実際の動作に影響する——という知見です。

これは「他人事」じゃない。会社員のAI活用に何を意味するか

「Anthropicの研究の話でしょ、自分には関係ない」と思うかもしれません。でも、この研究には日常的なAI利用者にとって大切な示唆が含まれています。

AIに「コンテキスト」を与えることの重要性

Anthropicの研究が示したのは、AIの動作は「何を読ませるか」に大きく依存するということ。これはつまり、あなたがAIを使うときも同じです。

単に「この資料を要約して」と頼むより、「あなたはXXの役割を担っており、読み手はYYを目的にしている。この前提で要約して」と伝えた方が、意図通りの結果が得られやすい。プロンプトに文脈を加えることは、研究が示す「価値観の共有」に近い行為です。

プロンプトの書き方を基礎から学びたい方は、こちらの記事も参考にしてください → プロンプトエンジニアリング完全ガイド

「AIを信頼しきらない」設計を意識する

もうひとつの学びは、エージェント型AIを使うときは「チェックポイントを設ける」ことの大切さです。

Anthropicの研究でも「ミスアライメントをゼロにする」とは言っていません。3分の1以下に「減らせる」という話です。完全な安全はなく、リスクを管理しながら使う姿勢が現実的です。

具体的には:

– 長い自動処理をさせる場合、中間で確認ステップを入れる

– 重要な判断を含むタスクはAIだけに任せない

– アウトプットの「なぜそうしたか」を確認する習慣をつける

この3点だけでも、意図しない動作のリスクはかなり下がります。

「AIの安全性」が、ビジネスの差別化要因になる時代

AIの安全性やアライメントの話は、つい「エンジニアや研究者の問題」と思いがちです。でも、2025年以降のビジネス環境では、これは現場の会社員にも直結する課題になりつつあります。

企業でのAI活用が進む中で、「AIが意図通りに動いているか確認できる人材」の価値は上がっています。技術的に深く理解する必要はありませんが、「AIの出力を鵜呑みにせず、意図とのズレを検知できる」スキルは、今後確実に重宝されます。

Anthropicのような企業が安全性の研究を続けていること自体、この問題が業界全体の優先課題であることを示しています。一方、現場の利用者側も「安全に使いこなす」視点を持つことが、これからのAIリテラシーの基本になるでしょう。

AIスキルを仕事やキャリアに活かしたい方は → AI副業・キャリアアップ完全ガイド

まとめ

Anthropicの研究が示したのは、「AIの価値観形成には、直接的な命令だけでなく、文脈や物語も影響する」という事実です。フィクション+行動規範文書の組み合わせで、AIの意図ズレが3分の1以下に減ったという結果は、AIが「どう学ぶか」の本質的な問いに触れています。

会社員としての現実的な教訓は3つ。AIにはできるだけ豊富なコンテキストを与えること、エージェント型AIを使うときはチェックポイントを設けること、そしてAIの安全性への理解がこれからのビジネススキルになるということ。

まずは手元のChatGPTやClaudeを使うときに、「このAIは今、何を根拠にこの答えを出しているか」と一度考えてみてください。それだけで、AIとの付き合い方が少し変わります。