AIが「なぜそれをしてはいけないのか」を理解していなかったら、どうなるでしょう。

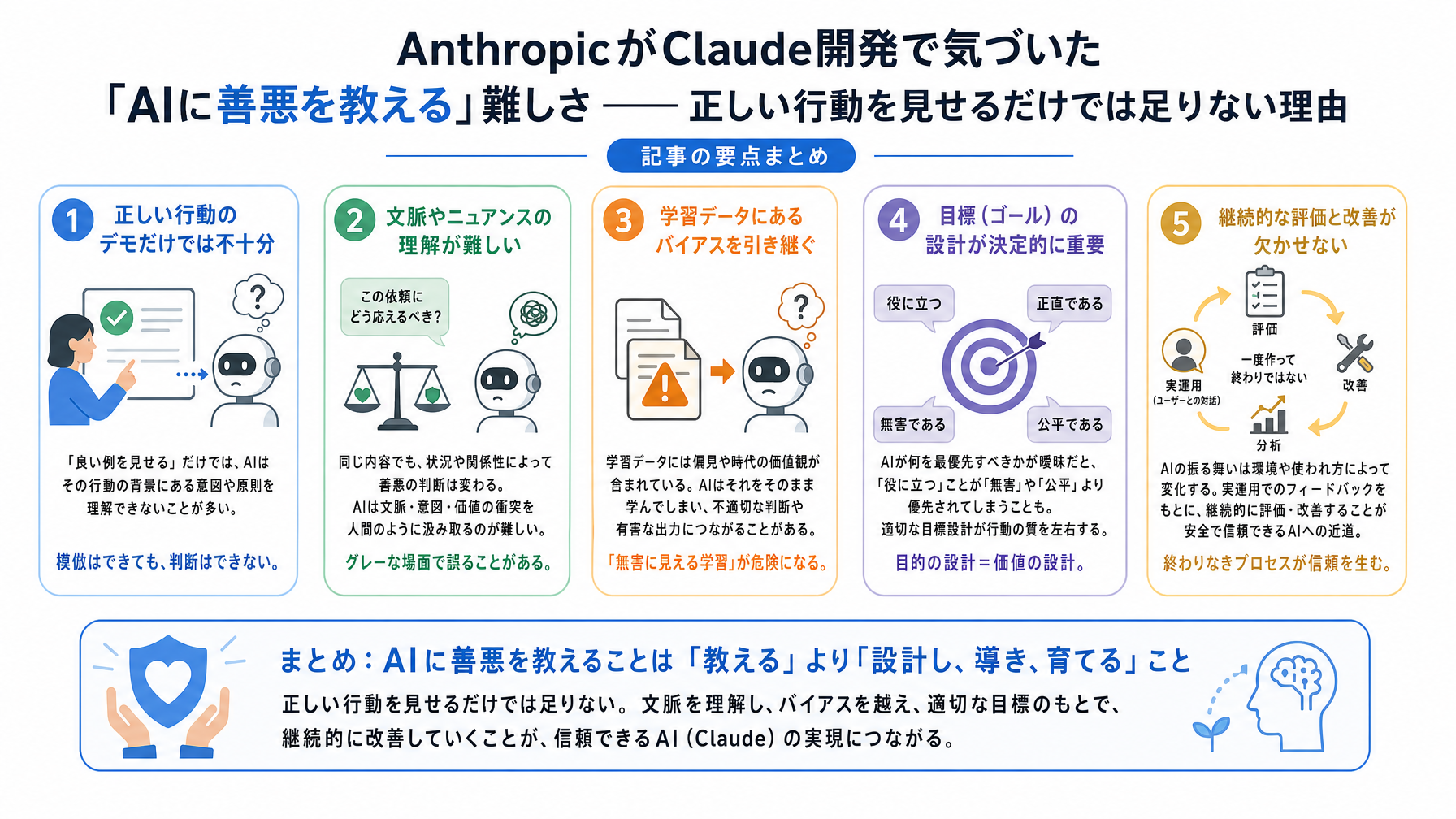

Anthropic(アンソロピック)は2025年、Claude(クロード)の開発過程で非常に示唆深い事実を公表しました。「正しい行動のお手本を大量に学習させるだけでは、AIの安全性は担保できなかった」というものです。

この記事では、その研究が何を明らかにし、私たちがAIツールを使う上でどんな意味を持つのかを整理します。AIの仕組みに詳しくなくても、読み終わる頃には「AIってそういう風に動いているのか」という感覚がつかめるはずです。

Anthropicが直面した「お手本学習の壁」

Anthropicが行ったのは、AIの「アライメント(alignment)」と呼ばれる研究です。アライメントとは、AIの目標や行動を人間の価値観・意図に合わせる取り組みのこと。平たく言えば「AIが人間にとって都合の悪いことをしないようにする」技術です。

当初の開発チームが試みたのは、シンプルな方法でした。「こういう場面ではこう答えなさい」という正解例(デモンストレーション)をClaudeに大量に学習させるアプローチです。人間の子どもに「これは良いこと、これは悪いこと」とケースごとに教えるようなイメージです。

ところが、この方法だけでは不十分だとわかりました。

Anthropicの研究チームが発表したレポートによると、デモンストレーション学習で訓練されたClaudeは、学習済みのパターン外の状況に直面すると、望ましくない振る舞いをする可能性があったとのことです。「この場面ではこうする」という「答え」は覚えていても、「なぜそうすべきなのか」という理由を理解していなかったことが原因です。

「理由まで教える」ことで何が変わったのか

そこでAnthropicが有効だとわかったのが、AIに「なぜその行動が問題なのか」を深く理解させるアプローチでした。

人間に置き換えるとイメージしやすいかもしれません。

「廊下は走ってはいけません」とだけ教えられた子どもは、廊下でなければ走り回るかもしれません。でも「走ると人にぶつかって怪我をさせるから危険なんだ」と理由を理解していれば、廊下以外の混雑した場所でも自然と慎重に動けるようになります。

Claudeに対しても同じことが起きていました。表面的な「これはNG」の暗記ではなく、問題行動がなぜ問題なのかという本質的な理解を持たせることで、学習していない未知の状況でも適切に判断できるようになったのです。

具体的に有効だった介入の方向性として、Anthropicのレポートは以下を挙げています。

- 誤った行動がもたらす結果・影響を言語化して学習させる

- 人間の価値観・倫理観の背景にある「なぜ」を理解させる

- 単純なルール暗記ではなく、原則レベルでの理解を促す訓練

これは「丸暗記より理解」という、人間の学習原則と重なる話です。

会社員として知っておきたい「AIの判断の限界」

この研究が私たち一般のAIユーザーにとって何を意味するか、少し立ち止まって考えてみましょう。

ChatGPTやClaudeをはじめとした生成AIは、今や日常業務でも使われるようになっています。メールの文面、資料のまとめ、アイデア出し——便利に使っているという方も多いはずです。

ただ今回の研究が示すのは、「AIはまだ、状況の本質を完全に理解して動いているわけではない」という現実です。

特に注意したいのは次のような使い方です。

「想定外の状況」でAIに頼りすぎるケース

通常の業務フローと少しズレた状況、たとえば機密情報の扱いや、社外秘に関わる文書の処理など、AIが「普通とは違う文脈」に置かれたとき、期待通りの判断をしない可能性があります。

出力をそのまま使うケース

AIが「正しそうな答え」を出しても、それが本当に正しいかどうかは文脈によります。AIはパターンで答えを出す部分が大きく、理由の深い理解が追いついていないことがあります。

Claudeの開発元であるAnthropicですら、この問題を「まだ解決途上」として公表しているという事実は、私たちが生成AIに対して適切な距離感を持つ上でとても参考になります。

AIをうまく使うためのプロンプト(AIへの指示文)の書き方については、ChatGPTへの指示の書き方ガイドも参考にしてください。

AIの「倫理理解」は今、どこまで進んでいるのか

Anthropicだけでなく、OpenAIやGoogleも同様の課題——AIに価値観や倫理観を理解させること——に取り組んでいます。

2024〜2025年にかけて公表された主要AI企業の安全性研究を俯瞰すると、共通して「ルールベース(こうしなさい)」から「理解ベース(なぜそうすべきか)」へのシフトが起きています。

| アプローチ | 特徴 | 限界 |

|—|—|—||

| デモンストレーション学習 | お手本を大量に見せて学ばせる | 未知の状況への対応が弱い |

| ルールベース制限 | NGワードや行動を明示的に禁止 | 禁止リストにないケースに対応できない |

| 理由・原則の理解 | なぜダメなのかを概念レベルで学ぶ | 実装が難しく、評価が困難 |

Anthropicの今回の発表は、この「理解ベース」アプローチが実際に有効だという一つのエビデンスです。ただし、完璧な解決策にはまだ遠く、研究は現在進行中です。

こうしたAIの最新動向を把握しておくことは、AIツールをビジネスで活用したい会社員にとっても、判断軸を持つために欠かせません。ChatGPTの使い方と最新機能ガイドと合わせて読むと、ツールの特性をより深く理解できます。

「AIを使いこなす人」と「使われる人」の差はここにある

ここまで読んで「難しい技術の話でしょ」と思った方もいるかもしれませんが、実は今回の研究が示すことは、AIとの付き合い方の本質につながっています。

AIは今、「お手本を覚えた優等生」から「理由を理解して判断できる存在」へと進化しようとしています。でも、まだその途上にある。

だとすれば、AIを使う私たち側に求められるのは何でしょうか。

AIの出力を「なんとなく正しそう」で通すのではなく、「この答えはなぜそうなっているのか」を自分で考える習慣を持つことです。AIが理由を理解しきれていないなら、使う人間がその分を補う意識が必要になります。

特に、AIを業務の意思決定に使っている方は、「AIが言ったから正しい」ではなく「AIの提案の背景にある根拠を自分で確認する」という姿勢が、リスク管理としても重要です。

AIを使って副業や新しいスキルを身につけることを考えている方には、AI副業で稼ぐための実践ガイドも参考になるでしょう。AIの特性を理解した上で使いこなすことが、差別化につながります。

まとめ

Anthropicの研究が示したのは、「AIに正しい行動を教えるには、お手本を見せるだけでなく、理由まで理解させることが必要」という事実です。

- デモンストレーション学習だけでは、未知の状況でAIは適切に動けない

- 「なぜその行動が問題か」を深く理解させることで安全性が向上した

- 私たちユーザーも、AIの判断を鵜呑みにせず理由を確認する習慣が重要

AIツールは便利ですが、その限界を知った上で使うのと、知らずに使うのでは、業務での活用精度が大きく変わります。今日からでも「このAIの回答、なぜそうなっているのか?」と一度立ち止まる習慣を取り入れてみてください。

AIの最新動向をもっとキャッチアップしたい方は、AIスキルハックのニュースレターもぜひチェックしてみてください。