AnthropicがClaudeに「憲法」を与えたことを、あなたはご存じでしょうか。

そのドキュメントが2024年、執筆者本人の声でオーディオブック化されました。AIの中身がどう設計されているかを、開発者自身が語るという、かなり異例のコンテンツです。

この記事では、「Claude’s Constitution」とは何か、なぜ今これが話題なのか、そして私たちビジネスパーソンがAIを使う上で何を意識すべきかをひも解きます。技術者向けの難しい話ではなく、AIを仕事に活かしたい人向けの読み物として書きました。

ClaudeのAI憲法とは何か、3分でわかる解説

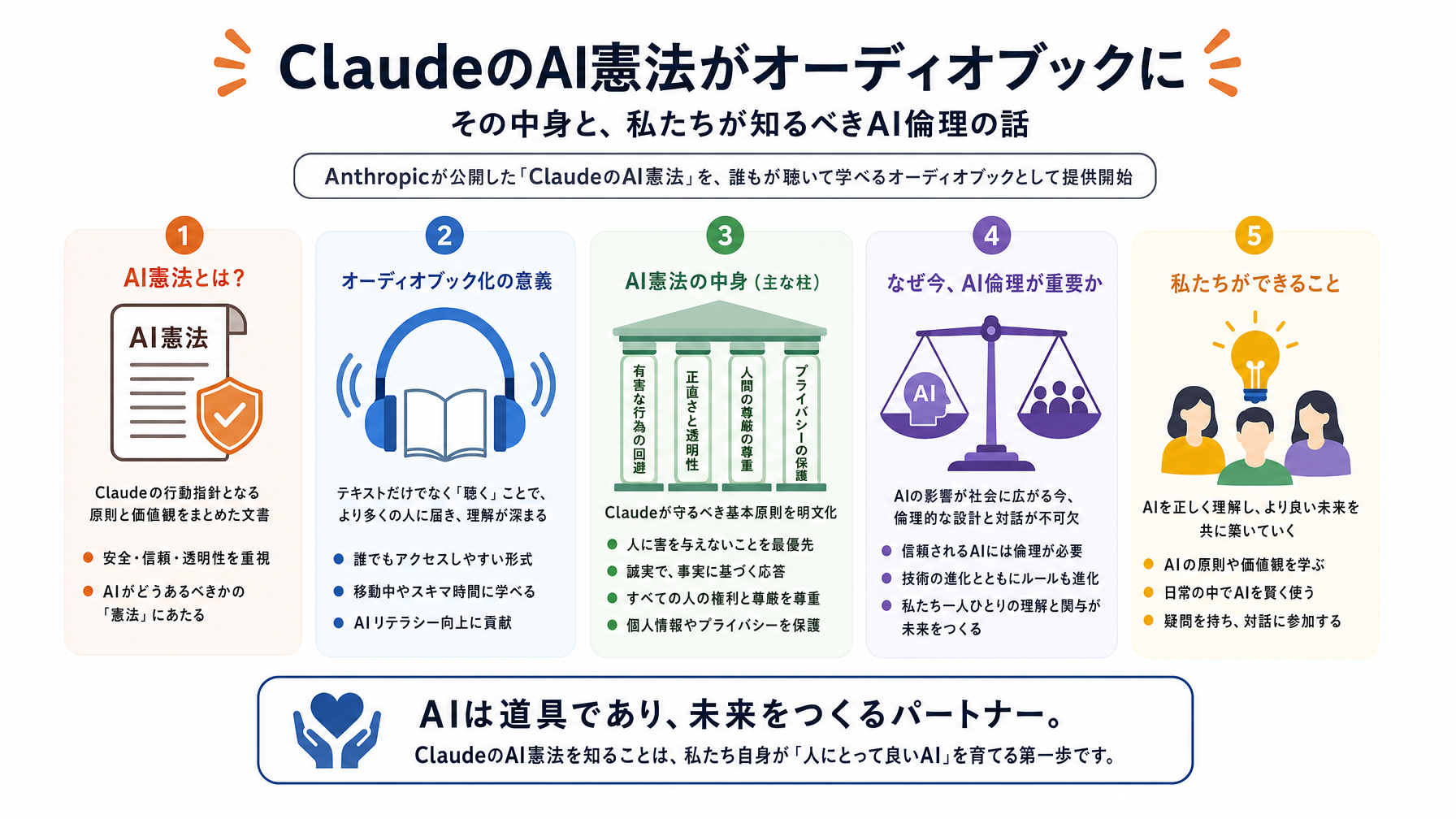

「AI憲法(Claude’s Constitution)」とは、AIがどう考え、どう振る舞うべきかを文章で定めたガイドラインです。法律の「憲法」をイメージすると近いかもしれません。

Anthropicが公開しているこのドキュメントは、Claudeが回答する際の価値観の根拠になっています。たとえば「有害なコンテンツを生成しない」「嘘をつかない」「ユーザーの自律性を尊重する」といった方針が、具体的な哲学的根拠とともに書かれています。

これがオーディオブック化されたことの意味は、単なるフォーマット変換ではありません。執筆者のAmanda AskellとJoe Carlsmithが自ら朗読し、Q&Aセッションも収録されています。「なぜこの文章を書いたのか」「どんな哲学的立場から書いているのか」「AIがより賢くなったら内容はどう変わるのか」——こうした問いに、開発者本人が答えているのです。

「AIに哲学を持たせる」という発想が生まれた背景

ChatGPTが登場した2022年末以降、AIに対して「なんでも答えてくれる便利ツール」というイメージが広まりました。ただ、そのイメージの裏側で開発者たちが頭を悩ませてきたのが「AIはどこまでやっていいのか」という問いです。

Anthropicはその問いに、哲学的なアプローチで答えようとしました。単純なルールリストを作るのではなく、なぜそのルールが存在するのかを文章で説明するスタイルを採用したのです。

Amanda Askellはこの憲法の主要執筆者のひとりで、AI安全性と倫理の研究者です。彼女がオーディオブックの中で語っているのは、「AIに明確な価値観を与えることで、予測不能な振る舞いを減らせる」という考え方です。

この考え方は、実は私たちが部下や新入社員を教育するときの発想に似ています。「このケースはこうしてください」という指示の羅列より、「なぜこうするのか」の背景を伝えたほうが、想定外の状況にも対応できる——そういう思想がAI開発にも持ち込まれているわけです。

日本のビジネス現場への影響:AIの「中身」を知ることの意味

「ブラックボックス」から「理解できるもの」へ

AIを使っている多くの人が感じている不安のひとつが、「なぜそう答えたのかわからない」という問題です。Claudeのような大規模言語モデル(LLM)は、入力した質問に対して確率的に回答を生成するため、同じ質問でも微妙に答えが変わることがあります。

こうした「ブラックボックス」感は、ビジネスで使うときの信頼性への不安につながります。AI憲法の公開・オーディオブック化は、その不安を少しでも解消しようとする取り組みとも言えます。

「このAIはこういう価値観で動いている」とわかれば、使う側も適切な使い方を考えられます。

AIの出力を正しく評価できるビジネスパーソンになる

Claude’s Constitutionが面白いのは、Claudeが「完全な正確さより、誠実さを優先する」「確信がないときは不確かさを表明する」と設計されている点です。

つまり、Claudeが「わかりません」と答えるとき、それは失敗ではなく意図的な設計です。このことを知っているかどうかで、AIの出力の読み方が変わります。

実際に日本の職場でChatGPTやClaudeを使い始めたとき、「AIが自信なさそうに答えた」という理由で結果を信頼しないケースがあります。しかし設計思想を知っていれば、「これは不確実性を正直に伝えている」と解釈できます。

AIリテラシーの本質は、ツールを使いこなすスキルだけでなく、ツールの設計思想を理解して適切に評価する力にあります。

Claude vs ChatGPT:倫理設計アプローチの違い(独自比較)

以下は、ClaudeとChatGPTの倫理・安全設計の違いを整理した比較表です。公開情報をもとにAIスキルハック編集部が作成しました。

| 比較項目 | Claude(Anthropic) | ChatGPT(OpenAI) |

|---|---|---|

| 倫理方針の公開 | AI憲法として全文公開 | 利用規約・使用ポリシーを公開 |

| 設計哲学 | 哲学・倫理学に基づく文章で説明 | ルールベース+人間フィードバック |

| 不確実性の表現 | 明示的に「わからない」と答えるよう設計 | 自信度の表現は文脈依存 |

| 価値観の更新方針 | モデルの能力向上に応じて改訂を明示 | 定期的なポリシーアップデート |

| 透明性への姿勢 | 開発者が自ら語るオーディオブックを公開 | ブログ・研究論文での発信が中心 |

この比較から見えるのは、Anthropicが「透明性の積極的な発信」を差別化ポイントとしている点です。ChatGPTが世界標準的な地位を確立している中で、Claudeは「信頼できるAI」という軸で勝負しています。

オーディオブックを聴く前に知っておくべきこと

英語コンテンツだが、内容の要点は追える

残念ながら、現時点でオーディオブックは英語のみの提供です(Anthropic公式サイトで無料公開)。ただし、AI憲法のドキュメント自体は英文で読める上、要点は日本語の解説記事でもカバーされています。

英語が得意でなくても、要点だけ把握したいなら、Claude自身に「この憲法の要約をわかりやすく日本語で教えて」と聞くのが最も手っ取り早いです。皮肉なことに、自分の憲法を自分で説明させるわけです。

「AIの気持ち」を知るのは、使いこなすための近道

AIを道具として使うとき、その道具がどんな設計思想で作られているかを知ることは、使い方の精度を上げます。

たとえばプロンプト(AIへの指示文)を書くとき、「ClaudeはユーザーのAUTONOMY(自律性)を重視する設計」と知っていれば、「〇〇してください」より「〇〇について自分の考えを整理したいので手伝ってください」という書き方が響きやすいと推測できます。

プロンプトの書き方をもっと体系的に学びたい方は、プロンプトエンジニアリングの基本ガイドも参考にしてみてください。

まとめ:AIの「設計思想」を知ることがAIリテラシーの第一歩

ClaudeのAI憲法オーディオブック化は、「AIをブラックボックスのまま使い続けるのをやめよう」というAnthropicからのメッセージとも読めます。

この記事の要点を3行で:

– Claude’s ConstitutionはAIの行動指針を哲学的に説明したドキュメントで、今やオーディオブックとして無料で聴ける

– AIの設計思想を知ることで、出力の評価精度と使いこなしの質が上がる

– 「AIに正確さより誠実さを」という設計は、ビジネス活用の場面で重要な判断基準になる

次のアクション: まずはAnthropicのサイトでClaude’s Constitutionの概要を眺め、そのあとClaude自身に「あなたが大切にしている価値観を教えて」と聞いてみてください。AIの答えと設計書の一致具合を確かめるのは、思ったより面白い体験です。

AIを仕事に活かす方法をもっと探りたい方は、ChatGPTの基本的な使い方ガイドやAIを使った副業の始め方もあわせてどうぞ。